Avec l’annonce du Leica M11-P, « l’authenticité du contenu » passe enfin de la théorie à la pratique. Avec de nombreuses applications et caméras promettant bientôt de la prendre en charge, il est intéressant d’examiner de plus près cette fonctionnalité. Qu’est-ce que cela signifie, comment est-il mis en œuvre et comment pourrait-il aider à lutter contre les fausses nouvelles générées par l’IA ?

Qu’est-ce que l’authenticité du contenu ?

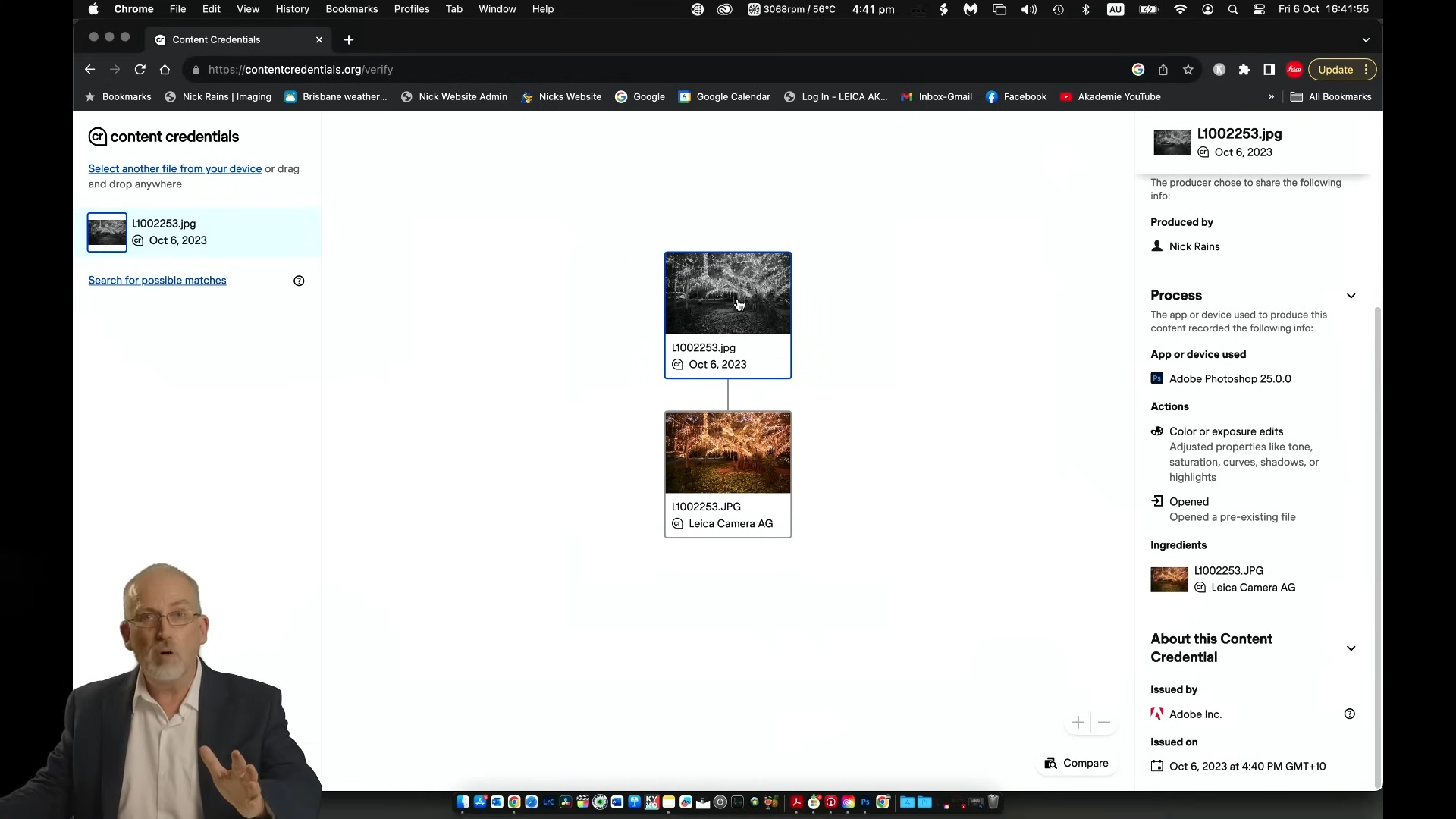

Content Authenticity est basé sur une nouvelle technologie C2PA (The Coalition for Content Provenance and Authenticity) développée par la CAI (Content Authenticity Initiative). En bref, il s’agit d’une technologie qui suit les informations sur les images. Plus précisément, le nom du créateur de l’image et la date de création de l’image. Pour ce faire, il « tamponne » la photo avec ces données. Il peut également suivre les modifications apportées ultérieurement à l’image. Si vous souhaitez lire l’explication technique, CAI a approfondi les détails sur sa page FAQ.

Le nom de ce « timbre » est Content Credentials.

Quels sont les problèmes que Content Authenticity résout ?

Connaissant les données originales d’une photo, il sera plus difficile de mentir sur les photos en cours de retouche. Il sera plus difficile de mentir sur le créateur de l’image. Et plus important encore, avec l’IA désormais omniprésente, il sera utile de savoir si l’image était réelle au départ.

À l’ère de la génération IA, de tels concepts deviennent de plus en plus courants en raison de la facilité d’utilisation de l’IA. Vous pouvez toujours modifier une image dans Photoshop, mais il ne s’agit plus que d’écrire une ligne de texte. Plus rapide, plus facile et contrairement à Photoshop, c’est quelque chose que tout le monde sait faire.

En termes de vol, la plupart des utilisateurs ne savent même pas que leur contenu généré par l’IA a été créé à partir des données de quelqu’un. Et qu’il a été généré sans autorisation. C’est parce que de nombreux outils d’IA utilisent simplement les données d’image qu’ils peuvent trouver. Dans le même ordre d’idées, si quelqu’un utilise votre image, vous ne le saurez malheureusement pas.

(Bien sûr, vous pouvez continuer à utiliser des filigranes pour essayer de vous protéger, mais des outils d’IA gratuits existent déjà pour vous en débarrasser. Et malheureusement, ils sont très efficaces… bien que ce soit un sujet différent.)

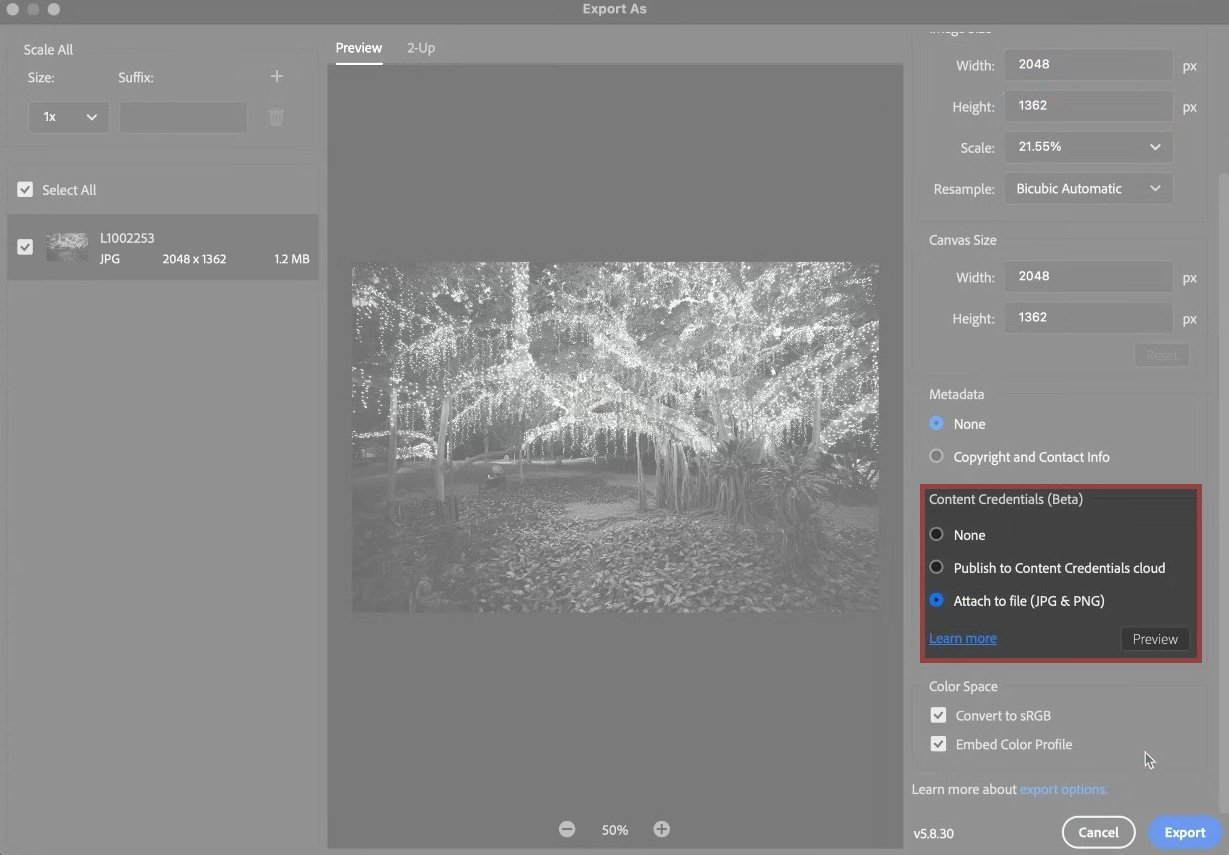

Flux de travail d’authenticité du contenu

Les caméras prises en charge vous donneront la possibilité d’inclure des informations d’identification telles que votre nom et la date de capture de l’image dans les données d’image. À partir de là, les applications d’édition prises en charge comme Adobe Photoshop garderont une trace des données intégrées et enregistreront une nouvelle couche d’informations. Cette nouvelle couche contiendra les informations de modification et les informations d’identification de l’éditeur.

Cela semble être un flux de travail assez simple. En théorie, cela résout les deux problèmes dont nous avons parlé :

- Il permet aux éditeurs de savoir qui a pris une image et les modifications qu’elle a subies.

- Cela permet également de réduire le vol d’images. C’est un sujet de plus en plus préoccupant à l’ère de la génération de l’IA.

Cette initiative aidera les créateurs de contenu ou les photojournalistes, car elle vise à accroître la crédibilité et la transparence du contenu numérique. Ceci est pertinent sur les plateformes de médias sociaux comme Twitter et des sites d’information numérique comme le New York Times, la BBC ou le Wall Street Journal.

Pouvez-vous simuler des informations d’identification de contenu ?

Les informations d’identification de contenu peuvent ressembler à davantage de métadonnées attachées à une image. Ce n’est pas très différent des métadonnées ou des EXIF que nous avons depuis des années. Un type de données que nous pouvons simplement… modifier. Facilement! Cela soulève la question : quelqu’un ne peut-il pas simplement modifier les crédits du contenu et falsifier la preuve intégrée ?

Pas assez. La technologie C2PA, à la base de l’initiative CAI, est cryptée. Cela signifie que vous ne pouvez pas (en théorie) modifier les enregistrements de crédits de contenu.

Ainsi, en théorie, peu importe ce qui arrive à l’image après sa prise de vue, vous pourrez la déposer dans l’outil de vérification CAI et voir son historique. A la racine, vous verrez l’image originale, avec la date et les références du photographe. À partir de là, vous pourrez voir l’image modifiée, qui l’a modifiée et quelles modifications exactes ont été apportées.

Mais on peut en dire autant de bien d’autres choses. Prenez Photoshop, par exemple. Vous n’êtes pas censé pouvoir utiliser gratuitement une copie piratée. Pourtant, vous le pouvez. C’est évidemment faux, mais c’est un phénomène extrêmement courant. Cela soulève une inquiétude quant à la force de la technologie Content Authenticity. Il vient de sortir et personne ne l’utilise encore. Par conséquent, personne n’essaie de faire semblant… Pour l’instant. L’histoire regorge de protocoles de cryptage qui ont été brisés. Du décryptage de DVD aux PlayStation Sony et même aux iPhone. Finalement, quelqu’un le fera essaie de briser réussir également à briser l’authenticité du contenu. Même si j’espère que l’expérience antérieure a renforcé ce protocole, je ne suis pas optimiste.

Je veux dire, les gens utilisent probablement l’IA pour « piller » des images protégées par le droit d’auteur. Qui peut dire que ces mêmes outils d’IA n’évolueront pas uniquement pour supprimer également les informations sur l’authenticité du contenu ?

Pourquoi cela vous semble-t-il familier ?

Canon et Nikon a déjà essayé la technologie Content Authenticity. Les deux ont échoué. Mais pourquoi? Ce qui s’est passé? Quand est-ce arrivé ?

En décembre 2010, ElcomSoft, une société de sécurité russe, a annoncé avoir piraté le logiciel de cryptage de Canon. Un logiciel utilisé pour prouver que les photographies étaient authentiques et non modifiées. Ils ont récidivé avec le logiciel d’authentification d’images de Nikon en 2011. Cette fois, ils ont même publié des images ridicules qui ont quand même réussi la validation.

Entreprises qui prennent déjà en charge l’authenticité du contenu

Leica vient de lancer le premier appareil photo sur le marché prenant en charge cette technologie, le Leica M11-P. Mais ils ne sont pas les seuls. Leurs concurrents (ou partenaires, d’ailleurs) ont annoncé des projets similaires.

Sony, par exemple, a annoncé que son prochain Sony a9iii soutiendrait cette initiative. Ils mettront également à jour certaines de leurs caméras existantes. Même certaines caméras de leurs téléphones. De même, Nikon a annoncé que son Nikon Z9 serait mis à jour avec la technologie CAI, mais nous n’avons toujours pas de date pour la mise à jour.

En termes de logiciels prenant en charge l’authenticité du contenu, nous avons déjà mentionné Adobe Photoshop, mais Lightroom et Firefly le prennent également en charge. Ce sont toutes des applications Adobe, mais comme la technologie est open source, n’importe quelle application peut être mise à jour pour la prendre en charge sur toute la ligne.

L’authenticité du contenu est-elle suffisamment mature pour réussir ?

Il est possible que la nouvelle initiative Content Authenticity devienne une norme de l’industrie. Beaucoup dépend encore de l’ampleur de l’adoption initiale. C’est une sorte de situation de poule et d’œuf. Pour que l’authenticité du contenu réussisse, nous avons besoin que toutes les parties prenantes l’adoptent. Nous avons besoin de caméras avec authenticité de contenu provenant d’un plus grand nombre de marques, mais nous avons également besoin que les médias incluent la vérification CA dans leurs flux de travail.

Deux autres facteurs majeurs sont la facilité d’utilisation et la solidité de ce protocole. Il est difficile de prendre une décision définitive tant que nous n’aurons pas constaté une adoption concrète.

L’authenticité du contenu résoudra-t-elle tout ?

Non. Comme le dit CAI : « Non, il existe généralement trois manières de lutter contre la désinformation : l’éducation, la détection et l’attribution. Le CAI crée une solution axée sur l’attribution. En d’autres termes, cette technologie n’est qu’un outil qui contribuera au problème et ne le résoudra pas à elle seule. La désinformation peut exister même avec des images réelles et non éditées, tout dépend du contexte.

Prenez par exemple cette photo d’un bâtiment effondré après un tremblement de terre au Népal en 2019 :

Avez-vous vérifié si ce bâtiment vient réellement du Népal avant de continuer ? Ce bâtiment s’est peut-être effondré exprès pour des travaux de construction. Peut-être que c’est dû à un tremblement de terre, mais ce n’est pas au Népal, ou cela ne s’est pas produit en 2019. Vous ne le saurez pas à moins de vérifier, et dans la plupart des cas, c’est ce que les gens ne font pas. Vérifier. Les nouvelles ces jours-ci arrivent rapidement. La plupart des gens voient le titre et l’image et continuent.

Rares sont ceux qui vérifient le contenu. Moins nombreux sont ceux qui examinent la situation dans son ensemble. Et même parmi eux, certains peuvent choisir de croire ce qu’ils veulent eux-mêmes croire. En tant que telles, des informations telles que les informations d’identification du contenu – un outil conçu pour la vérification des informations – ne vous aideront pas à moins que vous ne choisissiez de creuser vous-même.

Conclusion

Cela ne va donc pas tout résoudre, mais la nouvelle technologie de CAI est néanmoins passionnante. C’est une méthode pour lutter contre la désinformation, à condition que vous soyez prêt à l’utiliser. Eh bien, c’est ce qu’il est censé devenir, et c’est pourquoi suffisamment d’entreprises le soutiennent.

C’est un projet open source, mais il est encore nouveau. Le temps nous dira à quel point il deviendra accessible et à quel point il deviendra populaire. Le temps nous dira également s’il peut être piraté ou non. Vous n’êtes peut-être pas optimiste quant au CAI, compte tenu de l’échec des tentatives passées, mais je recommande tout de même de garder un œil sur cette technologie. Cela pourrait devenir un outil utile et fiable à l’avenir. Peut-être même un protocole standard dans l’industrie de la photographie.